近日,一段据称拍摄于美国纽约拉瓜迪亚机场事故现场的短视频在社交平台传播。画面中,受损严重的客机机头高高翘起,前景还有警员站立,给人一种“现场近距离拍摄视频”的印象。但经核查,这段视频并非事故发生时的原始现场视频,而是依附真实事故照片,由人工智能二次生成的“拟现场视频”。

值得警惕的是,这种“真事件+假视频”的组合,比普通假图、假消息更容易让人相信。

面对这类信息,普通受众该如何警惕?这又对人工智能治理提出了哪些新的挑战?

拉瓜迪亚机场“坠机视频”从哪来?

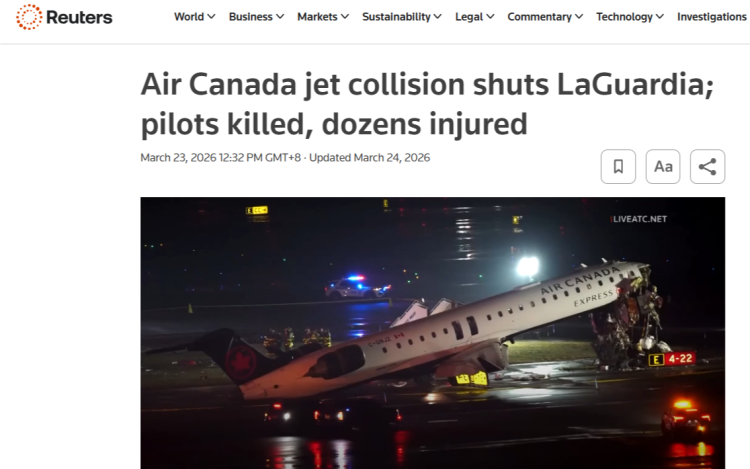

先看事故本身。当地时间3月22日晚,一架加拿大航空快运客机在纽约拉瓜迪亚机场降落时,与一辆机场消防救援车相撞,造成两名飞行员死亡、多人受伤。也就是说,事故是真的,伤亡情况也是真的。

路透社报道截图

问题出在后续传播的影像上。事故发生后不久,社交平台上迅速出现了一段所谓“现场近距离拍摄”的短视频。视频里,机头受损严重,前景还有警员站立,画面很像手机拍下的第一现场,因而具有很强迷惑性。

网传拉瓜迪亚机场所谓"坠机现场"视频

不过,沿着传播链条往前追,这段视频并非事故发生时的原始视频,而是由静态照片加工生成而来。海外社交平台X上,账号@Surflick 在发布时就直接写明,这是一张由人工智能大模型Grok依据真实照片制成的动画画面。也就是说,先有真实事故照片,再有AI生成的动态视频。

根据现有公开可见信息,目前可追溯到的较早传播节点之一,由账号@AZ_Intel在X平台发布的事故近景静态图。航空资讯网站自航航空(Paddle Your Own Kanoo)3月23日在报道中,直接引用了该账号发布的近景图,配文是“机舱前部严重受损的近景照片”。而在@AZ_Intel发布照片大约14分钟后,账号Surflick发布了基于事故照片生成的动态视频。

真实事故图片和AI动态生成图片在社交平台的发布情况

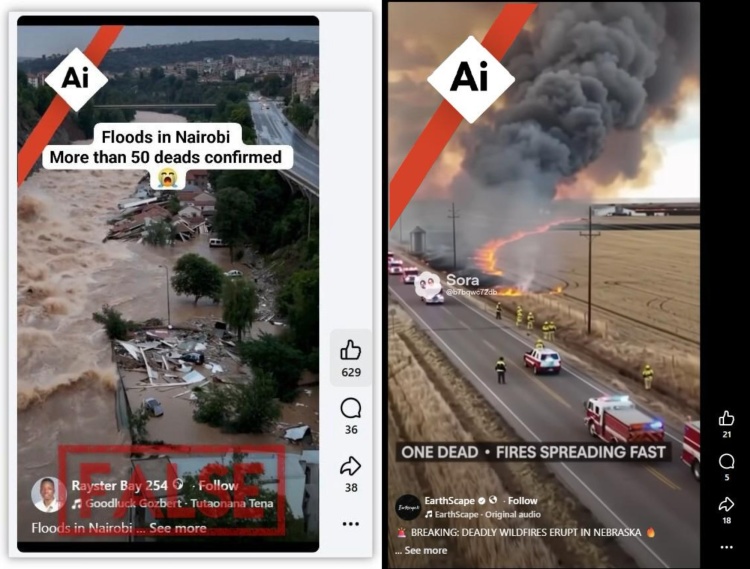

这起事件最值得警惕的地方,不是“事故是假的”,而是“真事故+假视频形态”。类似情况,近期并不少见。比如,3月肯尼亚内罗毕洪灾造成至少70人死亡后,社交平台上很快出现多段所谓“灾情现场视频”和图片,后经核查发现,其中一些内容其实是AI生成,并非真实灾区画面。

再如,美国内布拉斯加州3月发生该州史上最大规模山火后,网上也迅速流传多张所谓火场影像。多家核查机构指出,这些画面并不真实,而是虚构内容。

社交平台流传的"肯尼亚内罗毕洪灾"和"内布拉斯加州山火"AI图片

“真事故+假视频/图片”,这类信息背后传播的逻辑非常相似:都依附于真实灾难事件,借助公众对突发现场画面的关注,伪装成“第一现场”迅速扩散,因此更具迷惑性。

那么,面对这种“真事件+假视频”的新型误导内容,普通受众该如何识别?科技平台和AI企业又该如何应对?中国国际问题研究院世界和平与安全研究所助理研究员谢卉就此接受了总台环球资讯的采访。

这类“半真半假”的内容为何能得到迅速传播?

谢卉指出,这种“真事故+人工智能制作的假视频”的传播形态,本质上是一种“更隐蔽的造假方式”。

以拉瓜迪亚机场事件为例,事故本身是真实发生的,但网上流传的一些视频“并不是现场拍摄,而是由静态图片二次生成的动态画面”。之所以传播这么快,核心有三点:

一是真假混合,降低了公众警惕。

二是视频比图片更有冲击力,容易被当成“第一手目击”或“现场拍摄”。

三是平台算法会放大这种“高情绪、高关注”的内容。

谢卉强调,这类内容的风险,已经“不只是信息不够准确”,它还可能“误导公众的判断”,也可能在灾害现场“干扰救援”,长期来看,更会削弱社会对信息的基本信任。

而且,随着技术发展,类似造假还会继续演化,可能“不只是图像、视频”,还可能包括“语音克隆、换脸播报、伪造文件”等,从内容造假进一步走向“身份造假”甚至“权威造假”。

真假难辨 普通受众如何应对?

谢卉认为,当前人工智能生成内容已经高度逼真,普通人“很难只靠肉眼、靠听力去判断真假”。因此,关键不在于“能不能去识别它是不是AI生成”,而在于“如何处理那些可能引起怀疑的内容”。

谢卉建议,公众至少把握三个重点:

第一,对“现场直击”“刚刚流出”等说法保持高度警惕。

第二,要看信息有没有明确来源,“是谁拍的,什么时候发布的”。

第三,尽量做更多的交叉验证,看看“权威媒体或官方有没有同步此类信息”。

科技企业应变身“守门人”

谢卉强调,平台和科技企业在其中“不是旁观者”,而是“守门人”的角色。一方面,在生成端要做好标识,让AI生成内容“一眼可识别”;另一方面,在传播端要加强审核,尤其是灾害、事故等高风险场景。再则,还应建立快速辟谣或溯源机制,“不能只追求流量而忽视治理”,否则就可能放大平台或科技企业这类“半真半假”视频造成更大风险的可能性。

面对此类挑战 国内有什么应对措施?

谢卉提出,应对此类挑战,国内已不只是停留在原则倡议层面,而是已形成了一套比较完整的治理体系。

首先在规则层面,2022年已出台《互联网信息服务深度合成管理规定》,明确禁止利用人工智能制作、传播虚假信息,并要求平台落实实名审核、内容管理和辟谣机制;2023年的《生成式人工智能管理办法》,又进一步将责任压实到内容生成和传播全过程。

其次在技术标志层面,最新的《人工智能安全治理框架2.0》和《生成合成内容标志办法》明确提出,要建立“显示标志和隐式标志机制”,“既让用户看得见,也要实行可追溯”,同时推动数字水印等技术应用,从源头提升识别能力。

第三,在平台应用层面,在政务公开、司法取证等关键场景,已经要求部署深度伪造检测工具,对疑似人工智能内容进行来源核验和交叉验证,同时压实平台“守门人责任”。

在国际层面,我国也提出了全球人工智能治理倡议和人工智能全球治理行动计划,强调“以人为本、智能向善”,反对利用人工智能制造虚假信息,推动构建“可审查、可追溯”的全球治理体系。

近日,一段据称拍摄于美国纽约拉瓜迪亚机场事故现场的短视频在社交平台传播。画面中,受损严重的客机机头高高翘起,前景还有警员站立,给人一种“现场近距离拍摄视频”的印象。但经核查,这段视频并非事故发生时的原始现场视频,而是依附真实事故照片,由人工智能二次生成的“拟现场视频”。

值得警惕的是,这种“真事件+假视频”的组合,比普通假图、假消息更容易让人相信。

面对这类信息,普通受众该如何警惕?这又对人工智能治理提出了哪些新的挑战?

拉瓜迪亚机场“坠机视频”从哪来?

先看事故本身。当地时间3月22日晚,一架加拿大航空快运客机在纽约拉瓜迪亚机场降落时,与一辆机场消防救援车相撞,造成两名飞行员死亡、多人受伤。也就是说,事故是真的,伤亡情况也是真的。

路透社报道截图

问题出在后续传播的影像上。事故发生后不久,社交平台上迅速出现了一段所谓“现场近距离拍摄”的短视频。视频里,机头受损严重,前景还有警员站立,画面很像手机拍下的第一现场,因而具有很强迷惑性。

网传拉瓜迪亚机场所谓"坠机现场"视频

不过,沿着传播链条往前追,这段视频并非事故发生时的原始视频,而是由静态照片加工生成而来。海外社交平台X上,账号@Surflick 在发布时就直接写明,这是一张由人工智能大模型Grok依据真实照片制成的动画画面。也就是说,先有真实事故照片,再有AI生成的动态视频。

根据现有公开可见信息,目前可追溯到的较早传播节点之一,由账号@AZ_Intel在X平台发布的事故近景静态图。航空资讯网站自航航空(Paddle Your Own Kanoo)3月23日在报道中,直接引用了该账号发布的近景图,配文是“机舱前部严重受损的近景照片”。而在@AZ_Intel发布照片大约14分钟后,账号Surflick发布了基于事故照片生成的动态视频。

真实事故图片和AI动态生成图片在社交平台的发布情况

这起事件最值得警惕的地方,不是“事故是假的”,而是“真事故+假视频形态”。类似情况,近期并不少见。比如,3月肯尼亚内罗毕洪灾造成至少70人死亡后,社交平台上很快出现多段所谓“灾情现场视频”和图片,后经核查发现,其中一些内容其实是AI生成,并非真实灾区画面。

再如,美国内布拉斯加州3月发生该州史上最大规模山火后,网上也迅速流传多张所谓火场影像。多家核查机构指出,这些画面并不真实,而是虚构内容。

社交平台流传的"肯尼亚内罗毕洪灾"和"内布拉斯加州山火"AI图片

“真事故+假视频/图片”,这类信息背后传播的逻辑非常相似:都依附于真实灾难事件,借助公众对突发现场画面的关注,伪装成“第一现场”迅速扩散,因此更具迷惑性。

那么,面对这种“真事件+假视频”的新型误导内容,普通受众该如何识别?科技平台和AI企业又该如何应对?中国国际问题研究院世界和平与安全研究所助理研究员谢卉就此接受了总台环球资讯的采访。

这类“半真半假”的内容为何能得到迅速传播?

谢卉指出,这种“真事故+人工智能制作的假视频”的传播形态,本质上是一种“更隐蔽的造假方式”。

以拉瓜迪亚机场事件为例,事故本身是真实发生的,但网上流传的一些视频“并不是现场拍摄,而是由静态图片二次生成的动态画面”。之所以传播这么快,核心有三点:

一是真假混合,降低了公众警惕。

二是视频比图片更有冲击力,容易被当成“第一手目击”或“现场拍摄”。

三是平台算法会放大这种“高情绪、高关注”的内容。

谢卉强调,这类内容的风险,已经“不只是信息不够准确”,它还可能“误导公众的判断”,也可能在灾害现场“干扰救援”,长期来看,更会削弱社会对信息的基本信任。

而且,随着技术发展,类似造假还会继续演化,可能“不只是图像、视频”,还可能包括“语音克隆、换脸播报、伪造文件”等,从内容造假进一步走向“身份造假”甚至“权威造假”。

真假难辨 普通受众如何应对?

谢卉认为,当前人工智能生成内容已经高度逼真,普通人“很难只靠肉眼、靠听力去判断真假”。因此,关键不在于“能不能去识别它是不是AI生成”,而在于“如何处理那些可能引起怀疑的内容”。

谢卉建议,公众至少把握三个重点:

第一,对“现场直击”“刚刚流出”等说法保持高度警惕。

第二,要看信息有没有明确来源,“是谁拍的,什么时候发布的”。

第三,尽量做更多的交叉验证,看看“权威媒体或官方有没有同步此类信息”。

科技企业应变身“守门人”

谢卉强调,平台和科技企业在其中“不是旁观者”,而是“守门人”的角色。一方面,在生成端要做好标识,让AI生成内容“一眼可识别”;另一方面,在传播端要加强审核,尤其是灾害、事故等高风险场景。再则,还应建立快速辟谣或溯源机制,“不能只追求流量而忽视治理”,否则就可能放大平台或科技企业这类“半真半假”视频造成更大风险的可能性。

面对此类挑战 国内有什么应对措施?

谢卉提出,应对此类挑战,国内已不只是停留在原则倡议层面,而是已形成了一套比较完整的治理体系。

首先在规则层面,2022年已出台《互联网信息服务深度合成管理规定》,明确禁止利用人工智能制作、传播虚假信息,并要求平台落实实名审核、内容管理和辟谣机制;2023年的《生成式人工智能管理办法》,又进一步将责任压实到内容生成和传播全过程。

其次在技术标志层面,最新的《人工智能安全治理框架2.0》和《生成合成内容标志办法》明确提出,要建立“显示标志和隐式标志机制”,“既让用户看得见,也要实行可追溯”,同时推动数字水印等技术应用,从源头提升识别能力。

第三,在平台应用层面,在政务公开、司法取证等关键场景,已经要求部署深度伪造检测工具,对疑似人工智能内容进行来源核验和交叉验证,同时压实平台“守门人责任”。

在国际层面,我国也提出了全球人工智能治理倡议和人工智能全球治理行动计划,强调“以人为本、智能向善”,反对利用人工智能制造虚假信息,推动构建“可审查、可追溯”的全球治理体系。